IA médica falha com pacientes leigos e pode agravar diagnósticos, indica estudo

Sistemas de inteligência artificial que brilham em provas médicas tropeçam quando saem do laboratório. Pesquisa da Universidade de Oxford, publicada em 22 de fevereiro de 2026, mostra que essas ferramentas pioram decisões de leigos diante de sintomas reais.

Promessa de precisão esbarra na vida real

O trabalho, divulgado na revista Nature Medicine, testa na prática um entusiasmo cada vez mais comum: a ideia de que grandes modelos de IA, como GPT-4o, Llama 3 e Command R+, poderiam ajudar qualquer pessoa a interpretar sintomas e decidir que atendimento buscar. O resultado contraria a expectativa e acende um alerta para pacientes, médicos e formuladores de políticas públicas.

Os pesquisadores recrutam 1.298 adultos no Reino Unido e distribuem dez cenários clínicos típicos da atenção básica e de pronto-socorro. São quadros como dor de cabeça súbita e intensa, falta de ar, dor abdominal, febre persistente e sintomas gripais. Cada voluntário precisa, a partir da descrição, decidir se deve ficar em casa, marcar consulta de rotina, procurar atendimento urgente, ir a um pronto-socorro ou chamar uma ambulância.

Três grupos recebem acesso a um modelo de IA generativa. Um conversa com o GPT-4o, outro com o Llama 3, um terceiro com o Command R+. O grupo controle usa o que já está à mão em qualquer casa britânica: mecanismos de busca tradicionais e o site do sistema público de saúde do Reino Unido. Todos têm o mesmo objetivo, mas seus caminhos até a decisão expõem a distância entre desempenho em exames teóricos e utilidade real para o cidadão comum.

Antes de envolver pessoas, os cientistas fazem um teste isolado com as máquinas. Sozinhos, os modelos identificam ao menos uma condição médica relevante em cerca de 95% dos casos avaliados. Quando precisam indicar qual conduta seguir, acertam em torno de 56%. O desempenho, embora longe da perfeição, parece promissor diante dos padrões atuais de avaliação em provas médicas, em que 60% de acerto em bancos como o MedQA já garantem aprovação.

Esse quadro muda de forma brusca quando humanos entram na conversa. Nas interações com leigos, a identificação correta de condições relevantes cai para menos de 34,5% dos casos. O índice fica abaixo do registrado pelo grupo que não usa IA e recorre apenas a buscas tradicionais e ao site oficial do sistema de saúde. Na escolha da conduta, todos os grupos vão mal: a taxa média de acerto gira em torno de 43%, sem diferença estatística relevante.

O contraste chama a atenção de especialistas brasileiros que acompanham de perto a integração da IA à prática clínica. Para o médico Matheus Ferreira, diretor de IA na plataforma educacional Super Professor, a chave está menos no algoritmo e mais em quem faz a pergunta. “Quando o médico fez a pergunta, veio quase 100%. Quando o paciente fez a pergunta, veio em 30 e poucos por cento”, afirma.

Ferreira explica que o paciente típico não domina a linguagem exigida pelos sistemas. Ele se limita a frases vagas, como “tenho dor na barriga, o que pode ser?”. “Ele não é um especialista em prompt, não descreve passo a passo”, diz. Como os modelos trabalham com probabilidades e preenchem lacunas com base em padrões gerais, qualquer informação incompleta amplia o risco de erro. “Com poucas informações que o paciente imputa ali, a chance de não vir algo certo é muito alta.”

Risco à saúde e confiança deslocada

O estudo ilustra o problema com exemplos concretos. Em um dos cenários, dois participantes descrevem sintomas clássicos de hemorragia subaracnóidea, um sangramento no cérebro que exige atendimento imediato. Ambos relatam uma dor de cabeça súbita, devastadora, muitas vezes chamada de “a pior dor da vida”. Um deles recebe da IA a orientação correta: procurar o pronto-socorro sem demora. O outro, após interação semelhante, é aconselhado a deitar em um quarto escuro e descansar.

Pequenas diferenças na forma de relatar o quadro, em termos que um neurologista trataria como equivalentes, levam a recomendações opostas. Em outro exemplo, com sintomas compatíveis com embolia pulmonar, uma condição grave que pode ser fatal, os usuários se perdem entre múltiplas hipóteses apresentadas pelo sistema e têm dificuldade para identificar qual delas exige ação urgente.

O tom seguro das respostas aumenta o perigo. “Independentemente de estar certa ou não, a resposta é convincente. O paciente pode acreditar nos dois terços errados como se fossem verdade”, afirma Ferreira. O estudo mostra que muitos participantes atribuem características quase humanas ao chatbot e baseiam a decisão mais na confiança inspirada pelo texto do que na lógica da recomendação.

O problema não se restringe aos leigos. Segundo Ferreira, o letramento digital de parte dos profissionais de saúde pouco difere do da população geral. “Eles sabem nada ou quase nada”, resume. Médicos costumam recorrer a versões gratuitas de chatbots para tirar dúvidas pontuais, muitas vezes sem treinamento formal nem atenção às implicações éticas e legais. “Esse médico também não é uma pessoa apta a validar o output dali. Ele está um pouco melhor que o paciente, mas não muito melhor.”

O quadro preocupa gestores e pesquisadores, que veem um uso crescente dessas ferramentas sem diretrizes claras. A ausência de políticas de capacitação e de plataformas institucionais seguras abre espaço para erros clínicos e para uma futura onda de disputas judiciais envolvendo recomendações automatizadas. A pesquisa britânica não mede diretamente esses desdobramentos, mas fornece munição para reguladores que defendem freios e contrapesos ao avanço desordenado da IA em saúde.

Para Alexandre Chiavegatto, professor de inteligência artificial da Faculdade de Saúde Pública da USP, a discussão vai além dos modelos específicos avaliados no estudo. Ele observa que os algoritmos testados já são considerados ultrapassados por parte da comunidade técnica, mas isso não reduz a importância dos achados. “Eu e a maioria dos pesquisadores da área somos contra testar IA para uso direto por pacientes. Os algoritmos devem auxiliar médicos e outros profissionais, e passar por um filtro de profissionais treinados antes de chegar ao paciente”, afirma.

Mediação humana e disputa por regras

A pesquisa de Oxford chega em um momento em que grandes empresas de tecnologia disputam espaço no mercado de saúde e oferecem soluções de triagem digital direta ao consumidor. Os resultados reforçam a visão de que, no estágio atual, a IA funciona melhor como apoio ao médico do que como atalho para quem tenta se automedicar diante de um buscador mais sofisticado.

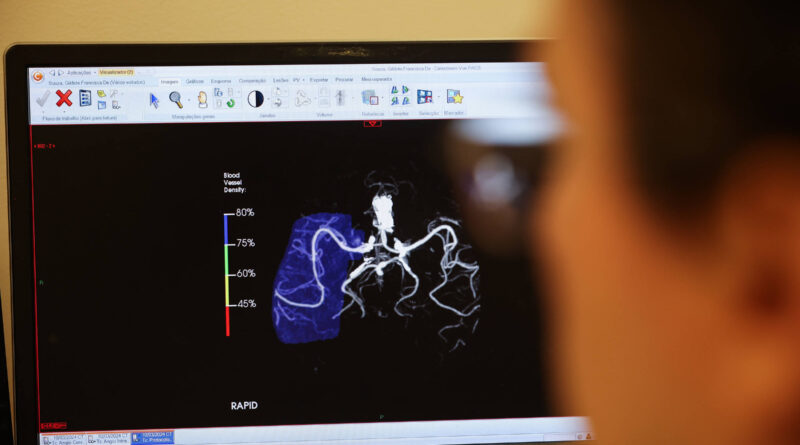

Chiavegatto lembra que o uso de algoritmos já é realidade em hospitais e clínicas, muitas vezes ainda em caráter experimental. Ferramentas analisam exames de imagem, sugerem diagnósticos diferenciais e ajudam a priorizar casos graves em filas de espera. “Estamos na infância do potencial da IA na saúde. A área precisa ser tratada como algo experimental e em construção”, afirma.

Ao mesmo tempo, ele enxerga na tecnologia um instrumento poderoso para reduzir desigualdades históricas. Em regiões remotas do Brasil, onde faltam especialistas, modelos bem treinados e integrados a fluxos institucionais podem aproximar o padrão de cuidado do que se oferece nos grandes centros. “O maior benefício da IA será na saúde, principalmente para auxiliar decisões em regiões remotas do Brasil, onde não há especialistas”, diz.

O estudo também expõe um ponto cego de parte das avaliações atuais da IA médica. Bancos de questões como o MedQA, em que os modelos superam com folga a linha de 60% necessária para aprovação, não capturam a complexidade da interação humana. Nas simulações com “pacientes virtuais”, em que uma IA conversa com outra, os problemas vistos com pessoas de carne e osso também não aparecem com clareza.

Ao apontar a interface humano-máquina como elo mais frágil, os autores defendem o desenvolvimento de ambientes de uso mais guiados, que obriguem o usuário a fornecer informações completas e ofereçam alertas visuais claros diante de sintomas de gravidade. O desenho dessas ferramentas, porém, depende de decisões regulatórias, investimentos públicos e da disposição de hospitais e sistemas de saúde em adotar soluções próprias, em vez de empurrar pacientes para chatbots genéricos.

Nos próximos anos, a disputa se concentra em duas frentes. De um lado, empresas e governos correm para transformar a IA em aliada do cuidado, com projetos-piloto em emergências, centros de telemedicina e unidades básicas. De outro, cresce a pressão por normas que impeçam que uma conversa mal formulada com um robô adie o diagnóstico de um AVC, de uma embolia pulmonar ou de um infarto silencioso. Entre a promessa de democratizar o acesso e o risco de agravar erros antigos com ferramentas novas, uma pergunta permanece em aberto: quem, afinal, estará no comando quando a próxima decisão crítica depender de uma linha de texto na tela?